Pengesan AI Palsu Pacu Penipuan 'Bayar-Untuk-Manusia' Dalam Ekosistem Maklumat

Dalam era ledakan maklumat salah yang semakin sukar dikawal oleh penyemak fakta profesional, muncul satu ancaman baharu yang berpotensi menambah lapisan penipuan tambahan kepada ekosistem maklumat yang sudah rapuh. Kajian terbaharu mendedahkan kewujudan alat pengesan teks kecerdasan buatan palsu yang bukan sahaja menghasilkan keputusan salah tetapi juga mempromosikan skim 'bayar-untuk-manusia' yang disifatkan pakar sebagai penipuan berstruktur.

Alat Pengesanan Yang Menyesatkan Dan Menipu

Penyemak fakta Agence France-Presse berjaya mengenal pasti tiga alat pengesan teks yang mendakwa mampu menganggarkan peratusan kandungan dihasilkan AI. Yang membimbangkan, alat-alat ini bukan sekadar salah mengenal pasti teks tulisan manusia sebagai kandungan AI tetapi turut cuba memonetikasi kesilapan tersebut melalui tawaran perkhidmatan berbayar.

JustDone AI, salah satu alat yang dikaji, memproses laporan tulisan manusia mengenai perang AS-Iran dan secara salah membuat kesimpulan bahawa ia mengandungi "88% kandungan AI". Selepas diagnosis yang salah ini, laman web tersebut terus menawarkan perkhidmatan membersihkan sebarang kesan AI dengan mengenakan bayaran tertentu.

"Teks AI anda sedang dipanusiakan," dakwa laman web tersebut, yang membawa pengguna ke halaman di mana "teks 100 peratus unik" dikunci di sebalik tembok bayaran yang mengenakan caj sehingga AS$9.99 (RM40.2). Dua alat lain iaitu TextGuard dan Refinely turut menghasilkan positif palsu yang serupa dan berusaha memonetikasi kesilapan tersebut.

Mekanisme Penipuan Yang Tersusun

Debora Weber-Wulff, ahli akademik berpangkalan di Jerman yang telah menyelidik alat pengesanan, memberikan penjelasan yang jelas mengenai fenomena ini. "Ini bukan pengesan AI tetapi penipuan untuk menjual alat 'pemanusiaan' yang sering mengembalikan apa yang kami panggil 'frasa terseksa'—jargon tidak berkaitan atau alternatif tidak masuk akal," katanya kepada AFP.

Kajian mendapati bahawa JustDone dan Refinely kelihatan beroperasi walaupun tanpa sambungan internet, mencadangkan keputusan mereka mungkin dihasilkan melalui skrip yang telah ditetapkan berbanding analisis teknikal yang tulen. Ciri ini menimbulkan persoalan serius mengenai keaslian dan ketepatan alat-alat tersebut.

Ujian Pelbagai Bahasa Mendedahkan Kelemahan

AFP memberikan pelbagai sampel tulisan manusia kepada alat-alat ini dalam empat bahasa berbeza: Belanda, Greek, Hungary dan Inggeris. Kesemuanya dilabel secara salah sebagai mempunyai kandungan AI yang tinggi, termasuk petikan daripada karya klasik Hungary 1916 yang terkenal.

Lebih membimbangkan, alat-alat ini terus mengembalikan bendera AI tanpa mengira input—malah untuk teks tidak masuk akal sekalipun. Satu pengguna di platform ulasan mengadu bahawa "walaupun dengan bahan 100% tulisan manusia, JustDone masih menandakannya sebagai AI."

Kesan Terhadap Institusi Pendidikan Dan Politik

Alat-alat yang diuji oleh AFP turut cuba menarik pelajar dan ahli akademik sebagai pelanggan, dengan dua daripadanya mendakwa pengguna mereka datang daripada institusi terkemuka seperti Universiti Cornell. Namun, Universiti Cornell memberitahu AFP bahawa mereka "tidak mempunyai sebarang hubungan yang ditetapkan dengan syarikat pengesan AI."

Universiti tersebut mengakui bahawa "AI generatif memang memberikan risiko meningkat bahawa pelajar mungkin menggunakannya untuk menghantar kerja yang bukan milik mereka," tetapi menegaskan bahawa "adalah tidak mungkin teknologi pengesanan akan memberikan penyelesaian yang boleh dilaksanakan untuk masalah ini."

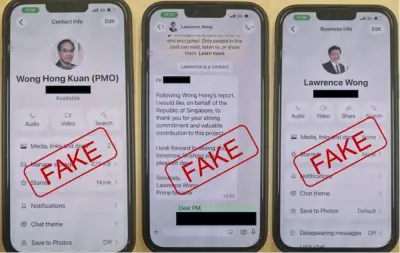

Dividen Pendusta Dan Penyalahgunaan Politik

Fenomena ini telah melahirkan taktik maklumat salah baharu yang dikenali penyelidik sebagai "dividen pendusta": menolak kandungan asli sebagai fabrikasi AI. Contoh praktikal muncul di Hungary awal tahun ini apabila pengaruh pro-kerajaan mendakwa dokumen yang menggariskan kempen pilihan raya pembangkang telah dihasilkan sepenuhnya oleh AI.

Untuk menyokong dakwaan tidak berasas ini, mereka mengedarkan tangkapan skrin di media sosial yang menunjukkan keputusan daripada JustDone. Kejadian ini menggambarkan bagaimana alat sedemikian boleh disalahgunakan untuk mendiskreditkan individu dan kumpulan politik tertentu.

Cabaran Dalam Pengesanan Visual AI

Penyemak fakta, termasuk mereka dari AFP, sering bergantung pada alat pengesanan visual AI yang dibangunkan pakar, yang biasanya mencari tanda air tersembunyi dan petunjuk digital lain. Namun, alat-alat ini juga kadangkala menghasilkan kesilapan, menjadikan perlu untuk menambah baik penemuan mereka dengan bukti tambahan seperti data sumber terbuka.

Implikasi Jangka Panjang Dan Ancaman Maklumat

Waqar Rizvi dari penjejak maklumat salah NewsGuard memberikan perspektif penting mengenai perkembangan ini. "Kami sering melaporkan tentang penyebar maklumat salah dan penipu lain menggunakan AI untuk memalsukan imej dan video," katanya. "Sekarang, kami memantau fenomena bertentangan, tetapi tidak kurang berbahaya: dakwaan bahawa visual dicipta oleh AI apabila sebenarnya, ia adalah asli."

Keputusan palsu daripada pengesan yang tidak boleh dipercayai mengancam untuk mengikis kepercayaan terhadap pengesahan AI secara meluas. Dalam ekosistem maklumat yang semakin kompleks, penipuan 'bayar-untuk-manusia' ini bukan sekadar eksploitasi kewangan tetapi ancaman serius terhadap integriti maklumat dan reputasi individu serta institusi.